heliaAOT

超高速ニューラル推論

heliaAOTは、LiteRTモデルを高度に最適化されたスタンドアロンC推論モジュールに変換する先行コンパイラで、Ambiqの超低消費電力SoC向けにカスタマイズされています。このコンパイラは、実行時のオーバーヘッドがなく、コンパクトで効率的、かつ人間が読めるCコードを生成し、エッジでのAIを高速かつ電力効率よく実現します。

heliaAOTは、LiteRTモデルを高度に最適化されたスタンドアロンC推論モジュールに変換する先行コンパイラで、Ambiqの超低消費電力SoC向けにカスタマイズされています。このコンパイラは、実行時のオーバーヘッドがなく、コンパクトで効率的、かつ人間が読めるCコードを生成し、エッジでのAIを高速かつ電力効率よく実現します。

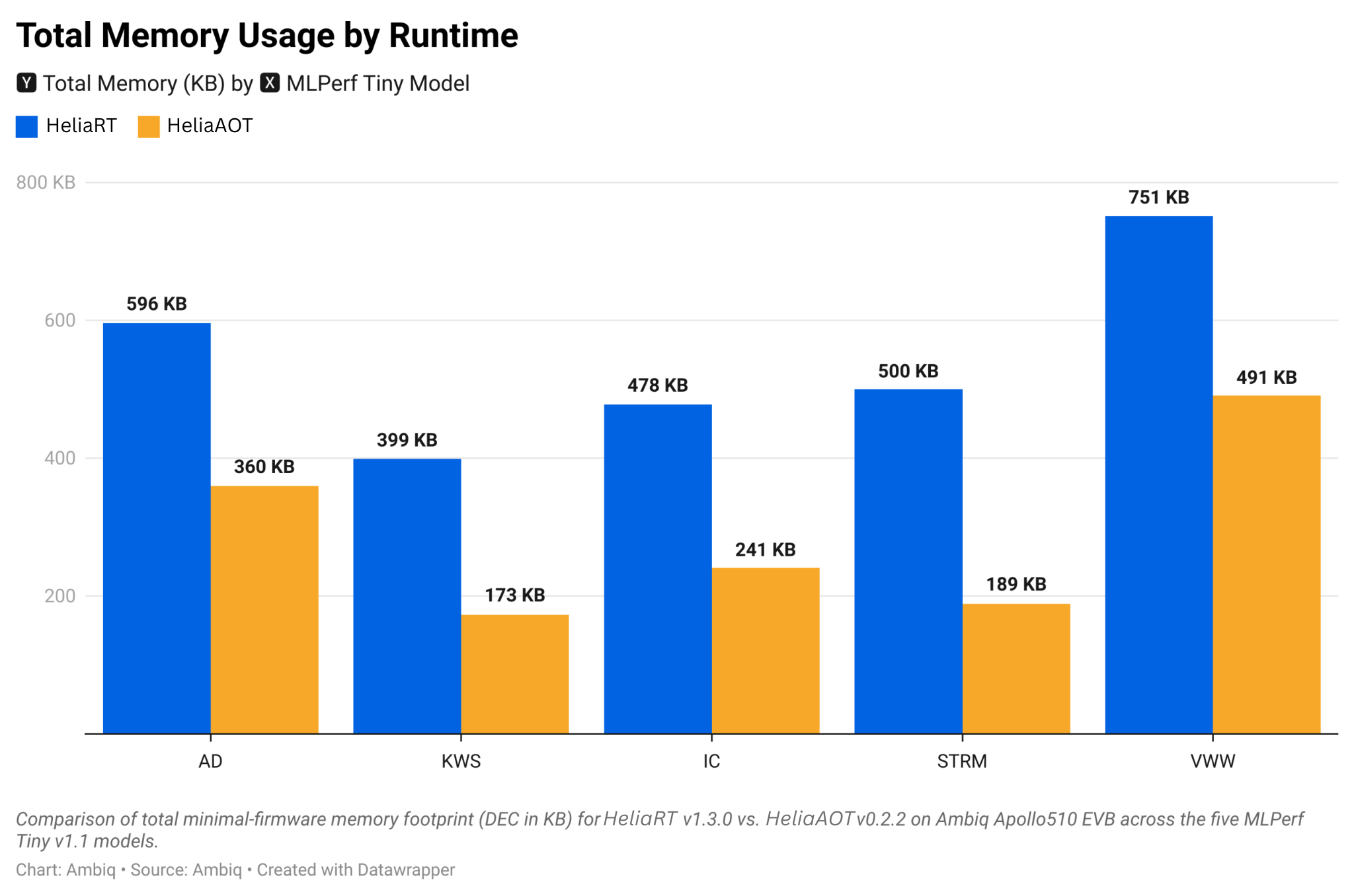

heliaRTレベルの推論スピードを小さなパッケージで-heliaAOTはMLPerf Tinyモデルのメモリフットプリントを最大2.6倍削減します。